基于深度学习和Contextual Loss的伪MRI图像生成研究

编号:56

稿件编号:59 访问权限:仅限参会人

更新:2021-10-30 18:32:04 浏览:1900次

张贴报告

摘要

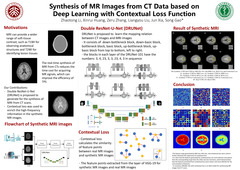

目的:磁共振成像(MRI)是一种广泛应用于疾病诊断的医学成像技术。在疾病诊断和放疗治疗计划中,与CT图像相比,MRI图像为临床医生和物理师提供了更详细的病理结构,从CT切片生成伪MRI图像能够缓解MRI图像采集时间长的问题。但伪MRI图像的生成存在许多困难,包括MRI图像中的高频信息较多、CT图像中软组织的分辨率较低等。本文提出了一种新的卷积神经网络,并引入Contextual损失函数,利用CT图像生成T1加权(T1WI)和T2加权图像(T2WI)。

材料与方法:获取35名志愿者的脑部图像,包括T1WI、T2WI和CT图像;然后利用仿射配准算法得到CT/MRI图像对,并对CT图像进行增强,增加软组织的对比度,并通过掩模处理消除CT和MR图像的背景噪声;最后,我们提出了一种基于ResNet的深度卷积神经网络,如图1(见上传全文)所示,对ResNet的结构进行改进和补充,分别构成U-Net的编码器和解码器,并将其命名为Double ResNet-U-Net(DRU-Net),并引入图像超分辨率中的Contextual损失函数优化模型参数。

结果:我们分别量化了生成图像的PSNR、SSIM和Tenengrad三个指标。如表1(见上传全文)所示,前两行是在相同的DRU-Net网络模型下,比较不同的损失函数,结果表明,与MSE损失函数相比,Contextual损失函数大大提高了生成MRI图像的质量;同时,在相同的Contextual损失函数下,将DRU-Net与前人提出的DCNN模型相比,生成的伪MRI图像质量相对较高;另外,基于DRU-Net和Contextual损失函数生成的T1WI和T2WI在图像细节的渲染能力上都比前两者强,如图2(见上传全文)所示。

结论:实验结果表明,DRU-Net能够很好地根据CT数据生成伪MRI图像,并且Contextual损失函数丰富了伪MRI图像中的高频信息,使得MRI图像中软组织显示更加清楚。

材料与方法:获取35名志愿者的脑部图像,包括T1WI、T2WI和CT图像;然后利用仿射配准算法得到CT/MRI图像对,并对CT图像进行增强,增加软组织的对比度,并通过掩模处理消除CT和MR图像的背景噪声;最后,我们提出了一种基于ResNet的深度卷积神经网络,如图1(见上传全文)所示,对ResNet的结构进行改进和补充,分别构成U-Net的编码器和解码器,并将其命名为Double ResNet-U-Net(DRU-Net),并引入图像超分辨率中的Contextual损失函数优化模型参数。

结果:我们分别量化了生成图像的PSNR、SSIM和Tenengrad三个指标。如表1(见上传全文)所示,前两行是在相同的DRU-Net网络模型下,比较不同的损失函数,结果表明,与MSE损失函数相比,Contextual损失函数大大提高了生成MRI图像的质量;同时,在相同的Contextual损失函数下,将DRU-Net与前人提出的DCNN模型相比,生成的伪MRI图像质量相对较高;另外,基于DRU-Net和Contextual损失函数生成的T1WI和T2WI在图像细节的渲染能力上都比前两者强,如图2(见上传全文)所示。

结论:实验结果表明,DRU-Net能够很好地根据CT数据生成伪MRI图像,并且Contextual损失函数丰富了伪MRI图像中的高频信息,使得MRI图像中软组织显示更加清楚。

关键字

伪MRI,放射治疗计划,UNet,ResNet,Contextual loss

报告人

发表评论